запретить индексацию папки robots txt

Руководство: как закрыть сайт от индексации в поисковых системах? Работа с файлом robots.txt

На стадии разработки и/или редизайна проекта бывают ситуации, когда лучше не допускать поисковых роботов на сайт или его копию. В этом случае рекомендуется закрыть сайт от индексации поисковых систем. Сделать это можно следующим образом:

Закрыть сайт от индексации очень просто, достаточно создать в корне сайта текстовый файл robots.txt и прописать в нём следующие строки:

User-agent: Yandex

Disallow: /

Такие строки закроют сайт от поискового робота Яндекса.

А таким образом можно закрыть сайт от всех поисковых систем (Яндекса, Google и других).

Как закрыть от индексации отдельную папку? #

Отдельную папку можно закрыть от поисковых систем в том же файле robots.txt с её явным указанием (будут скрыты все файлы внутри этой папки).

User-agent: *

Disallow: /folder/

Если какой-то отдельный файл в закрытой папке хочется отдельно разрешить к индексации, то используйте два правила Allow и Disallow совместно:

User-agent: *

Аllow: /folder/file.php

Disallow: /folder/

Как закрыть отдельный файл в Яндексе? #

User-agent: Yandex

Disallow: /folder/file.php

Как проверить, в индексе документ или нет? #

Проще всего осуществить проверку в рамках сервиса «Пиксель Тулс», бесплатный инструмент «Определение возраста документа в Яндексе» позволяет ввести URL списком. Если документ отсутствует в индексе, то в таблице будет выведено соответствующее значение.

Анализ проведён с помощью инструментов в сервисе Пиксель Тулс.

Как скрыть от индексации картинки? #

Картинки форматов jpg, png и gif могут быть запрещены к индексации следующими строчками в robots.txt:

User-Agent: *

Disallow: *.jpg

Disallow: *.png

Disallow: *.gif

Как закрыть поддомен? #

У каждого поддомена на сайте, в общем случае, имеется свой файл robots.txt. Обычно он располагается в папке, которая является корневой для поддомена. Требуется скорректировать содержимое файла с указанием закрываемых разделов с использованием директории Disallow. Если файл отсутствует — его требуется создать.

При использовании CDN-версии #

Как обращаться к другим поисковым роботам (список) #

У каждой поисковой системы есть свой список поисковых роботов (их несколько), к которым можно обращаться по имени в файле robots.txt. Приведем список основных из них (полные списки ищите в помощи Вебмастерам):

Прочие директивы в robots.txt #

Поисковая система Яндекс также поддерживает следующие дополнительные директивы в файле:

«Crawl-delay:» — задает минимальный период времени в секундах для последовательного скачивания двух файлов с сервера. Также поддерживается и большинством других поисковых систем. Пример записи: Crawl-delay: 0.5

«Clean-param:» — указывает GET-параметры, которые не влияют на отображение контента сайта (скажем UTM-метки или ref-ссылки). Пример записи: Clean-param: utm /catalog/books.php

«Sitemap:» — указывает путь к XML-карте сайта, при этом, карт может быть несколько. Также директива поддерживается большинством поисковых систем (в том числе Google). Пример записи: Sitemap: https://pixelplus.ru/sitemap.xml

Закрыть страницу и сайт с помощью meta-тега name=»robots» #

Также, можно закрыть сайт или заданную страницу от индексации с помощь мета-тега robots. Данный способ является даже предпочтительным и с большим приоритетом выполняется пауками поисковых систем. Для скрытия от индексации внутри зоны документа устанавливается следующий код:

Или (полная альтернатива):

С помощью meta-тега можно обращаться и к одному из роботов, используя вместо name=»robots» имя робота, а именно:

Для паука Google:

Или для Яндекса:

Запрет индексации в robots.txt

Чтобы убрать весь сайт или отдельные его разделы и страницы из поисковой выдачи Google, Яндекс и других поисковых систем, их нужно закрыть от индексации. Тогда контент не будет отображаться в результатах поиска. Рассмотрим, с помощью каких команд можно выполнить в файле robots.txt запрет индексации.

Зачем нужен запрет индексации сайта через robots.txt

Первое время после публикации сайта о нем знает только ограниченное число пользователей. Например, разработчики или клиенты, которым компания прислала ссылку на свой веб-ресурс. Чтобы сайт посещало больше людей, он должен попасть в базы поисковых систем.

Чтобы добавить новые сайты в базы, поисковые системы сканируют интернет с помощью специальных программ (поисковых роботов), которые анализируют содержимое веб-страниц. Этот процесс называется индексацией.

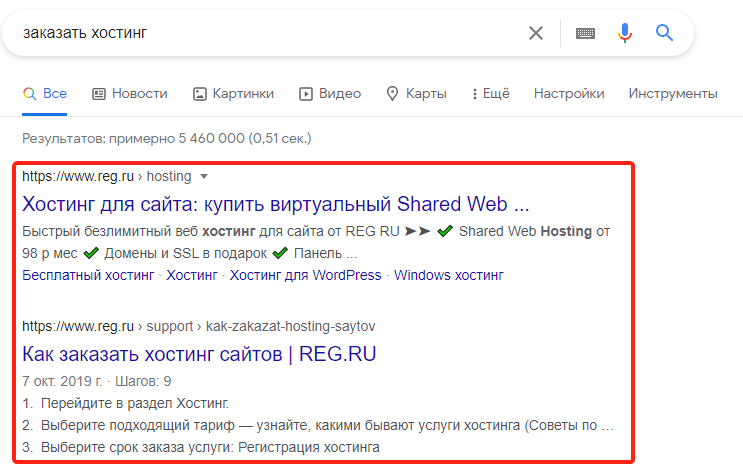

После того как впервые пройдет индексация, страницы сайта начнут отображаться в поисковой выдаче. Пользователи увидят их в процессе поиска информации в Яндекс и Google — самых популярных поисковых системах в рунете. Например, по запросу «заказать хостинг» в Google пользователи увидят ресурсы, которые содержат соответствующую информацию:

Однако не все страницы сайта должны попадать в поисковую выдачу. Есть контент, который интересен пользователям: статьи, страницы услуг, товары. А есть служебная информация: временные файлы, документация к ПО и т. п. Если полезная информация в выдаче соседствует с технической информацией или неактуальным контентом — это затрудняет поиск нужных страниц и негативно сказывается на позиции сайта. Чтобы «лишние» страницы не отображались в поисковых системах, их нужно закрывать от индексации.

Кроме отдельных страниц и разделов, веб-разработчикам иногда требуется убрать весь ресурс из поисковой выдачи. Например, если на нем идут технические работы или вносятся глобальные правки по дизайну и структуре. Если не скрыть на время все страницы из поисковых систем, они могут проиндексироваться с ошибками, что отрицательно повлияет на позиции сайта в выдаче.

Для того чтобы частично или полностью убрать контент из поиска, достаточно сообщить поисковым роботам, что страницы не нужно индексировать. Для этого необходимо отключить индексацию в служебном файле robots.txt. Файл robots.txt — это текстовый документ, который создан для «общения» с поисковыми роботами. В нем прописываются инструкции о том, какие страницы сайта нельзя посещать и анализировать, а какие — можно.

Прежде чем начать индексацию, роботы обращаются к robots.txt на сайте. Если он есть — следуют указаниям из него, а если файл отсутствует — индексируют все страницы без исключений. Рассмотрим, каким образом можно сообщить поисковым роботам о запрете посещения и индексации страниц сайта. За это отвечает директива (команда) Disallow.

Как запретить индексацию сайта

О том, где найти файл robots.txt, как его создать и редактировать, мы подробно рассказали в статье. Если кратко — файл можно найти в корневой папке. А если он отсутствует, сохранить на компьютере пустой текстовый файл под названием robots.txt и загрузить его на хостинг. Или воспользоваться плагином Yoast SEO, если сайт создан на движке WordPress.

Чтобы запретить индексацию всего сайта:

Добавьте в начало нужные строки.

Robots.txt и запрет индексации всего сайта

Хотите узнать, как запретить индексацию сайта в robots.txt и с помощью других инструментов? Тогда представленный материал – именно для вас.

Безусловно, владельцы сайтов борются за то, чтобы их ресурс как можно быстрее проиндексировался поисковыми системами. Но бывают случаи, когда необходимо, чтобы поисковый бот на какое-то время не посещал ресурс и не добавлял в свой индекс материалы с вашего web ресурса. Такими случаями могут быть:

Можно закрыть весь сайт целиком или же его отдельные части:

Есть много способов, с помощью которых можно закрыть сайт от индексации. Редактирование файла robots.txt – один из них. Мы рассмотрим этот способ и еще два наиболее популярных и простых.

Как закрыть сайт от индексации для Яндекса, Google и всех поисковых систем в robots.txt

Редактирование файла robots.txt – один из самых надежных и быстрых способов установить этот запрет для поисковых системам на какое-то время или же навсегда. Что для этого нужно сделать:

Запрет индексации в robots.txt сайта можно устанавливать как для конкретных поисковых систем, так и всех поисковиков. Мы рассмотрим разные варианты.

Чтобы закрыть сайт от индексации поисковыми ботами Google, потребуется в файле robots.txt написать следующее:

Для того, чтобы проверить, закрылся ли сайт от индексации, создается аккаунт и добавляется нужный домен в Google Webmaster. Здесь предусмотрена функция проверки.

После этого будут показаны результаты. Если сайт запрещен для индексации, то будет написано «Заблокировано по строке» и указано, какая строка блокирует индексацию. Если же какие-то действия по запрету индексации поисковыми ботами Google были выполнены некорректно, то будет подписано «Разрешено».

Следует учесть, что невозможно с помощью robots.txt поисковой системе Google на 100% запретить индексацию. Это своего рода рекомендация для Гугла, так как он сам решит, выполнять ли ему индексацию отдельного документа, или нет.

Чтобы закрыть материалы сайта от индексации Яндексом, в файле robots.txt нужно ввести следующее:

Для проверки статуса ресурса его нужно добавить в Яндекс Вебмастер, где затем нужно ввести несколько страниц со своего сайта и нажать кнопку «Проверить». Если все получилось, в строке будет высвечиваться надпись «Запрещен правилом».

Можно также установить запрет на индексацию вашего сайта одновременно для всех поисковых систем. Для этого, опять же, открываем файл robots.txt и прописываем в нем такую строку:

Проверка запрета индексации для Гугла и Яндекса выполняется по вышеописанной схеме в Google Webmaster и Яндекс Вебмастер соответственно.

Чтобы увидеть свой файл robots.txt, нужно перейти по адресу Вашдомен.ru/robots.txt. Здесь будет отображаться все, что было прописано. Бывает так, что появляется ошибка 404. Это говорит о том, что было выполнено что-то не так при загрузке своего файла.

Запрет индексации ресурса при помощи панели инструментов

Способ закрытия сайта от индексации с помощью панели инструментов подойдет только для тех ресурсов, которые были сделаны на Вордпресс.

Порядок действий простой и быстрый:

Выполнение данных действий – всего лишь рекомендация для поисковых машин. А то, будут ли индексироваться или не индексироваться материалы ресурса, они решают самостоятельно. В настройках видимости сайта даже присутствует специальная строка: «Поисковые машины сами решают, следовать ли Вашей просьбе». Отметим, что Яндекс обычно «слушается», а Гугл может поступать по своему усмотрению и все равно в некоторых случаях индексировать сайт, несмотря на рекомендацию.

Закрытие сайта от индексации вручную

В исходном коде при закрытии страницы или всего ресурса от индексации появляется строка

Именно эта строка подсказывает поисковым машинам, что не нужно индексировать отдельные материалы или ресурс. Можно вручную в любом месте сайта прописать данную строчку. Главное, чтобы она отображалась на всех страницах.

Этот способ подойдет также для того, чтобы закрыть какой-либо ненужный документ от индексации.

После выполнения обновлений нужно проверить, все ли получилось. Для этого нужно открыть исходный код с помощью клавиш CTRL + U и посмотреть, есть ли в нем нужная строчка. Ее наличие подтверждает успешную операцию по закрытию от индексации. Дополнительно можно осуществить проверку в Яндекс Вебмастер и Google Webmaster.

Итак, мы рассмотрели самые простые и быстрые способы, позволяющие закрыть весь сайт или отдельные материалы ресурса от индексации поисковыми машинами. И, как выяснилось, robots.txt – один из легких и относительно надежных способов.

Проверка индексации сайта онлайн

Методы ускорения индексации сайта в яндексе

Директивы в файле robots.txt

Как использовать robots.txt и кеш Гугла

Быстрая индексация сайта в Гугле

Seo – проверка индексации текста и веса ссылок тест

База знаний

Запретить индексацию страниц/директорий (robots.txt)

Все поисковые роботы при заходе на сайт в первую очередь ищут файл robots.txt. Это текстовый файл, находящийся в корневой директории сайта (там же где и главный файл index., для основного домена/сайта, это папка public_html), в нем записываются специальные инструкции для поисковых роботов. Эти инструкции могут запрещать к индексации папки или страницы сайта, указать роботу на главное зеркало сайта, рекомендовать поисковому роботу соблюдать определенный временной интервал индексации сайта и многое другое

Если файла robotx.txt нет в каталоге вашего сайта, тогда вы можете его создать.

Чтобы запретить индексирование сайта через файл robots.txt, используются 2 директивы: User-agent и Disallow.

User-agent: УКАЗАТЬ_ПОИСКОВОГО_БОТА

Disallow: / # будет запрещено индексирование всего сайта

Disallow: /page/ # будет запрещено индексирование директории /page/

1. Запретить индексацию вашего сайта ботом MSNbot

2. Запретить индексацию вашего сайта ботом Yahoo

User-agent: Slurp

Disallow: /

3. Запретить индексацию вашего сайта ботом Yandex

4. Запретить индексацию вашего сайта ботом Google

5. Запретить индексацию вашего сайта для всех поисковиков

6. Усложняем задачу и например Яндексу запрещаем индексировать папки cgi-bin и images, а Апорту файлы myfile1.htm и myfile2.htm в директории subdir (название папки где расположены файлы myfile1.htm и myfile2.htm)

User-agent: Yandex

Disallow: /cgi-bin/

Disallow: /images/

User-agent: Aport

Disallow: /subdir/myfile1.htm

Disallow: /subdir/myfile2.htm

7. Запрет индексации папок cgi-bin и images для всех поисковиков

User-agent: *

Disallow: /cgi-bin/

Disallow: /images/

Теперь как разрешить индексировать все страницы сайта всем поисковикам (примечание: эквивалентом данной инструкции будет пустой файл robots.txt):

P.S. Для различных CMS, в интернете можно найти рекомендации, какие директории лучше закрыть от индексации поисковиками., в большей степени это нужно ради безопасности и уменьшения нагрузки на сервер.

Связанные статьи

При установки какого либо движка (CMS), потребуется указать хост (host) к подключению базы.

Когда вы зашли по FTP или открыли Диспетчер файлов в CPanel, то директория для загрузки вашего.

Всем известно что когда вы копируете много мелких файлов на FTP, или на своем компьютере, с.

При установке скрипта Shop-Script PREMIUM выдает следующую ошибку:You have an error in your SQL.

Для этого существует специальная функция phpinfo(). Создайте в директории

Запретить индексацию папки robots txt

В рубрике «HTML» Вы найдете бесплатные уроки по работе с этим языком гипертекстовой разметки, который лежит в основе большинства сайтов.

Данная рубрика заменит Вам полноценный «HTML учебник». Здесь Вы сможете найти ответы на большинство вопросов, связанных с HTML и DHTML.

Бесплатные уроки HTML для начинающих

Помимо текстовых уроков, Вы также сможете найти на нашем сайте полезные видео уроки по HTML. Простые и понятные примеры и объяснения помогут Вам в кратчайшие сроки освоить этот базовый язык «сайтостроения».

Лайфхак: наиполезнейшая функция var_export()

При написании или отладки PHP скриптов мы частенько пользуемся функциями var_dump() и print_r() для вывода предварительных данных массив и объектов. В этом посте я бы хотел рассказать вам о функции var_export(), которая может преобразовать массив в формат, пригодный для PHP кода.

17 бесплатных шаблонов админок

Парочка бесплатных шаблонов панелей администрирования.

30 сайтов для скачки бесплатных шаблонов почтовых писем

Создание шаблона для письма не такое уж простое дело. Предлагаем вам подборку из 30 сайтов, где можно бесплатно скачать подобные шаблоны на любой вкус.

Как осуществить задержку при нажатии клавиши с помощью jQuery?

К примеру у вас есть поле поиска, которое обрабатывается при каждом нажатии клавиши клавиатуры. Если кто-то захочет написать слово Windows, AJAX запрос будет отправлен по следующим фрагментам: W, Wi, Win, Wind, Windo, Window, Windows. Проблема?.

15 новых сайтов для скачивания бесплатных фото

Подборка из 15 новых сайтов, где можно скачать бесплатные фотографии для заполнения своих сайтов.

50+ бесплатных Bootstrap 3 шаблонов и элементов UI

Подборка бесплатных UI материалов и Bootstrap 3 шаблонов за уходящий месяц.